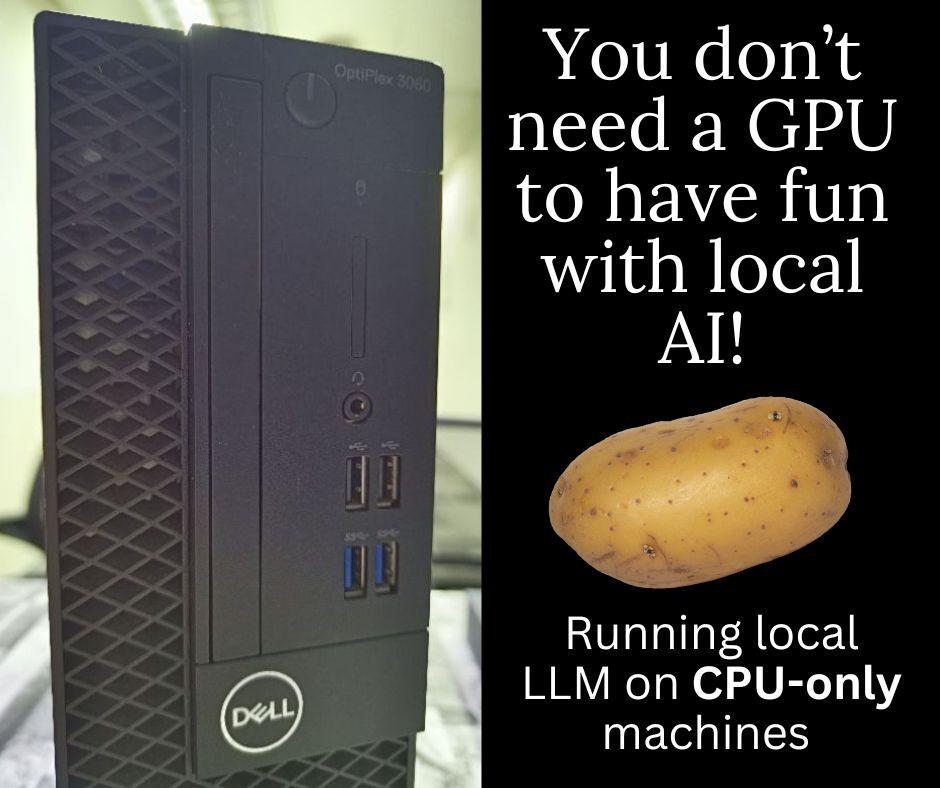

CPU 전용, GPU 컴퓨터 없이 모든 종류의 AI 도구를 로컬에서 실행할 수 있음

LocalLLaMA의 많은 사람들이 값비싼 설정을 사용하여 로컬에서 수행할 수 있는 작업으로 한계를 뛰어넘는 것은 훌륭한 일이지만, 아주 최소한의 기계로 많은 작업을 수행할 수 있다는 점을 기억해야 합니다.

저는 CPU 전용 로컬로 실행되는 LLM에 대해 이야기하고 있습니다. 맞습니다. **GPU가 없습니다!**

저는 i5-8500 프로세서, 6개 스레드, 32GB RAM을 갖춘 기존 Dell Optiplex 데스크탑에서 Linux Mint를 실행하고 있습니다. 120달러 정도에 리퍼브 제품 중 하나를 구입할 수 있습니다.

이 보잘것없는 장비를 사용하면 다음과 같은 일을 할 수 있습니다.

KoboldCPP를 사용하여 12B Q4_K_M gguf LLM을 실행합니다. 이를 통해 https://huggingface.co/spaces/DontPlanToEnd/UGI-Leaderboard에서 상당히 높은 평가를 받은 모델을 사용하여 로컬 챗봇을 재미있게 즐길 수 있습니다. 초기 프롬프트를 800개 토큰 미만으로 유지하는 한 응답 시간은 충분히 빠릅니다. 그리고 상황 전환을 통해 세션 중에 내용을 기억합니다. 무수정, 비공개 RP의 환희를 무료로! 텍스트 음성 변환을 위해 kokoro_no_espeak를 추가하면 RP 캐릭터가 단 몇 초의 지연만으로 대화할 수 있습니다. 비결은 사용할 좋은 모델을 찾는 것입니다. 예를 들어, DreadPoor/Famino-12B-Model_Stock은 쓰기에서 41+ 등급을 받았으며 이는 많은 70B 모델보다 낫습니다. 재미를 위해 큰 마력이 필요하지 않습니다.

또한 이러한 모델을 쓰기, 코딩 및 모든 종류의 애플리케이션에 사용할 수 있습니다. 다양한 지역 모델을 시험해보고 자신에게 맞는 설정을 찾으려면 인내심이 필요합니다.

또한 기본 이미지 생성, 인페인팅 등을 위해 Stable Diffusion 1.5를 로컬로 실행합니다. KoboldCPP와 Stable UI를 다시 사용합니다. 좋습니다. 512x512 이미지를 생성하는 데 3분이 걸리지만 잘 작동합니다. 그리고 loras와 다양한 SD 1.5 모델을 실험해 볼 수도 있습니다. 오래된 장비는 모두 100% 무료입니다.

또한 음성 복제 음성 해설 프로젝트를 위해 Chatterbox TTS를 실행하고 있습니다. 놀랍게도 잘 작동합니다. 다시 말하지만, 75단어 오디오 클립을 생성하는 데 몇 분이 걸리지만 작동합니다. Vibevoice TTS도 이 오래된 장비에서 작동하지만 저는 Chatterbox를 선호합니다.

그리고 로컬에서 이미지를 엄청나게 잘 확대하는 Upscayl과 같은 놀라운 도구가 있습니다. 모델을 가지고 실험을 해봐야 합니다.

나는 오디오 파일을 텍스트로 놀랍도록 잘 변환하는 ollama transcriber를 사용했습니다. .WAV라는 음성 단어를 가리키고 가서 저녁 식사를 하고 돌아오면 텍스트가 거기에 있습니다.

제가 사용해 본 다른 지역 LLM과 도구도 많이 있습니다. 이것은 빙산의 일각에 불과합니다.

동영상? 아니요. 음악세대? 아니요. 몇 가지를 살펴보고 시도했지만 이러한 대규모 리소스 작업에는 상당한 마력이 필요합니다. 그러나 텍스트 기반 작업에는 기존 데스크톱 컴퓨터를 사용한 다음 일회성 작업에는 온라인 GPU를 임대하고 다른 작업에는 대규모 온라인 서비스를 사용하는 것이 가능합니다. 아마도 여전히 비용이 적게 들 것입니다.

나는 이 일을 하는 유일한 사람이 아니라는 것을 안다.

CPU 전용 사용자: AI를 로컬에서 어떻게 사용하고 있는지 알려주세요...